Klar kann man die KI manchmal zu verräterischem Verhalten verleiten. Aber noch einfacher ist es, wenn die Webseite ihre Anweisungen an die KI selbst verrät.

Die Langversion dieses Artikels von Adrienne Fichter und mir gratis und werbefrei auf DNIP.ch: «Was KI-Webseiten so petzen»

Die KI-Kampagne

Die JUSO hat eine «Initiative für eine Zukunft» lanciert, die bei Vererbungen und Schenkungen den über 50 Millionen Franken hinausgehenden Betrag zu 50 % besteuern will. Die Economiesuisse hält dagegen und sucht Supporterinnen, die sich mit einem «persönlichen Statement» hinter die Position der Economiesuisse stellen sollen, wohl um der Kampagne ein Gesicht zu geben und die breite Verankerung in der Gesellschaft zu symbolisieren.

Scheinbar fällt es der Economiesuisse aber schwer, ihre Supporter zu einem «persönlichen Statement» zu motivieren. Deshalb kann man sich dieses auch – auf Basis von vor dem Benutzer geheim gehaltenen Argumenten und weiteren Anweisungen – mit ChatGPT generieren lassen. Das wirft Fragen nach Authentizität der Supporter-Statements und ausreichender Information vor der Einwilligung auf.

Sind sich die Supporterinnen beispielsweise bewusst, dass Worte wie «Schweizerin» und «Bürgerin» explizit im Text verboten sind und damit nur die männlichen Formen erzeugt werden?

Auch an anderer Stelle scheint die Economiesuisse an längst vergangenen Zeiten festzuhalten, insbesondere was Softwareentwicklung für Webserver betrifft: Zum einen liegen auf der JUSO-Nein-Webseite auch die Argumentarien von anderen Economiesuisse-Aktionen herum. Zum anderen kann die ChatGPT-Anbindung auch für nicht von Economiesuisse sanktionierte KI-Nutzung eingesetzt werden.

Der Einsatz von KI-Tools bei politischen Kampagnen bringt aber auch gefahren mit sich. Neben dokumentierten Fehlaussagen gibt es auch die Gefahr, dass die Meinung der Personen sich durch die ihnen in den Mund gelegten KI-Aussagen verändert.

«Wir stellen fest, dass sowohl das Schreiben der Teilnehmer:innen als auch ihre Einstellung zu sozialen Medien in der Umfrage erheblich von der bevorzugten Meinung des Modells beeinflusst worden ist».

Jakesch et al.: « Co-Writing with Opinionated Language Models Affects Users’ Views», CHI ’23

Die von den Proband:innen verfassten Statements näherten sich dem Positionsbezug des Chatbots an. Auch wenn die Probanden der Experimentalgruppe über das Manipulationspotenzial des KI-Assistenten aufklärte, änderte das nichts.

«Viel relevanter finde ich – und das zeigt das Beispiel gut: Durch die Verwendung von KI kann sich unser Informationsökosystem schleichend verändern, etwa indem es mit grossen Mengen an qualitativ minderwertigen KI-generierten Inhalten geflutet wird, statt uns Zugang zu qualitativ hochstehenden und zuverlässigen Informationen bereitzustellen.»

Angela Müller von AlgorithmWatch Switzerland

In der Schweiz werden solche KI-Aktionen wie der «JUSO Nein»-Kampagne keine Konsequenzen haben.

Während der europäische AI Act verlangt, dass Erzeugnisse von KI-Tools deklariert werden (wenn sie 1:1 übernommen werden), gibt es hierzulande keine Transparenzvorschriften. Und das wird auch bis mindestens 2027/8 so bleiben. Denn der Bundesrat plant ein allfälliges KI-Gesetz erst bis Ende 2026 auszuarbeiten.

Da könnte sich doch der Verband Economiesuisse doch an der ideologienahen FDP ein Beispiel nehmen.

Deren Grundsatz lautete beim Wahlkampf 2023:

«Wir deklarieren die Urheberschaft von KI bei der Erstellung von auditiven und / oder visuellen Kampagnenelementen.»

Mehr Hintergründe und KI-Prompts auf DNIP.ch: «Was KI-Webseiten so petzen»

Künstliche Intelligenz

News (mehr…)

- «Reddit rAIngelegt»: Hörkombinat-Podcast-Interview zur fragwürdigen KI-Manipulation an der Universität ZürichForschende der Uni Zürich haben KI-Bots in ein Forum der Plattform Reddit eingeschleust. Und zwar ohne Wissen der Betreiber:innen und… «Reddit rAIngelegt»: Hörkombinat-Podcast-Interview zur fragwürdigen KI-Manipulation an der Universität Zürich weiterlesen

- Forschung am Menschen ohne deren Wissen: Universität Zürich und Reddit «r/ChangeMyView»Wie DNIP.ch am Montag als erstes Medium berichtete, hat eine Forschungsgruppe mit Anbindung zur Universität Zürich mittels KI psychologische Forschung… Forschung am Menschen ohne deren Wissen: Universität Zürich und Reddit «r/ChangeMyView» weiterlesen

- KI-Webseiten petzen und beeinflussenKlar kann man die KI manchmal zu verräterischem Verhalten verleiten. Aber noch einfacher ist es, wenn die Webseite ihre Anweisungen… KI-Webseiten petzen und beeinflussen weiterlesen

Lange Artikel (mehr…)

- Persönliche Daten für Facebook-KIMeta – Zuckerbergs Imperium hinter Facebook, WhatsApp, Instagram, Threads etc. – hat angekündigt, ab 27. Mai die persönlichen Daten seiner Nutzer:innen in Europa für KI-Training zu verwenden. Dazu gehören alle… Persönliche Daten für Facebook-KI weiterlesen

- KI-DatenkreisläufeHier ein kleiner Überblick über die Datenkreisläufe rund um generative KI, insbesondere grosse Sprachmodelle (Large Language Model, LLM) wie ChatGPT, Gemini oder Claude.

- Der Homo Ludens muss Werkzeuge spielend erfahren. Auch KIFast alle Werkzeuge, die wir «spielend» beherrschen, haben wir spielend gelernt. Das sollten wir auch bei generativer KI.

- Der Turing-Test im Laufe der ZeitVor einem knappen Jahrhundert hat sich Alan Turing mit den Fundamenten der heutigen Informatik beschäftigt: Kryptographie, Komplexität/Rechenaufwand, aber auch, ob und wie wir erkennen könnten, ob Computer „intelligent“ seien. Dieses… Der Turing-Test im Laufe der Zeit weiterlesen

- «QualityLand» sagt die Gegenwart voraus und erklärt sieIch habe vor Kurzem das Buch «QualityLand» von Marc-Uwe Kling von 2017 in meinem Büchergestell gefunden. Und war erstaunt, wie akkurat es die Gegenwart erklärt. Eine Leseempfehlung.

- Neuralink ist (noch) keine Schlagzeile wertDiese Woche haben einige kurze Tweets von Elon Musk hunderte oder gar tausende von Artikeln ausgelöst. Wieso?

- «Quasselquote» bei LLM-SprachmodellenNeulich erwähnte jemand, dass man ChatGPT-Output bei Schülern häufig an der «Quasselquote» erkennen könne. Das ist eine Nebenwirkung der Funktionsweise dieser Sprachmodelle, aber natürlich noch kein Beweis. Etwas Hintergrund.

- «KI» und «Vertrauen»: Passt das zusammen?Vor einigen Wochen hat Bruce Schneier einen Vortrag gehalten, bei dem er vor der der Vermischung und Fehlinterpretation des Begriffs «Vertrauen» gewarnt hat, ganz besonders beim Umgang mit dem, was… «KI» und «Vertrauen»: Passt das zusammen? weiterlesen

- Wegweiser für generative KI-ToolsEs gibt inzwischen eine grosse Anzahl generativer KI-Tools, nicht nur für den Unterricht. Hier ein Überblick über verschiedene Tool-Sammlungen.

- KI-VergiftungEine aggressive Alternative zur Blockade von KI-Crawlern ist das «Vergiften» der dahinterliegenden KI-Modelle. Was bedeutet das?

- Lehrerverband, ChatGPT und DatenschutzDer Dachverband der Lehrerinnen und Lehrer (LCH) sei besorgt, dass es in der Schweiz keine einheitliche Regelung gäbe, wie Lehrpersonen mit Daten ihrer Schützlinge umgehen sollen und ob sie dafür… Lehrerverband, ChatGPT und Datenschutz weiterlesen

- Goethe oder GPThe?In «Wie funktioniert ChatGPT?» habe ich die Experimente von Andrej Karpathy mit Shakespeare-Texten wiedergegeben. Aber funktioniert das auch auf Deutsch? Zum Beispiel mit Goethe? Finden wir es heraus!

- KI: Alles nur Zufall?Wer von einer «Künstlichen Intelligenz» Texte oder Bilder erzeugen lässt, weiss, dass das Resultat stark auf Zufall beruht. Vor Kurzem erschien in der NZZ ein Beitrag, der die Unzuverlässigkeit der… KI: Alles nur Zufall? weiterlesen

- Hype-TechWieso tauchen gewisse Hype-Themen wie Blockchain oder Maschinelles Lernen/Künstliche Intelligenz regelmässig in IT-Projekten auf, obwohl die Technik nicht wirklich zur gewünschten Lösung passt? Oder es auch einfachere, bessere Ansätze gäbe?

- 📹 Die Technik hinter ChatGPTDer Digital Learning Hub organisierte 3 Impuls-Workshops zum Einsatz von ChatGPT in der Sekundarstufe II. Im dritten Teil präsentierte ich die Technik hinter ChatGPT. In der halben Stunde Vortrag werden… 📹 Die Technik hinter ChatGPT weiterlesen

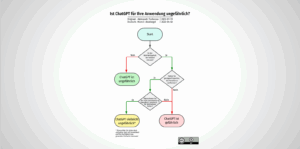

- Ist ChatGPT für Ihre Anwendung ungefährlich?Ob man KI-Chatbots sicher einsetzen kann, hängt von der Anwendung ab. Aleksandr Tiulkanov hat deshalb ein Flussdiagramm als Entscheidungshilfe erstellt. Hier eine deutsche Übersetzung und ein paar Anmerkungen zum Korrekturlesen… Ist ChatGPT für Ihre Anwendung ungefährlich? weiterlesen

- Wie funktioniert ChatGPT?ChatGPT ist wohl das zur Zeit mächtigste Künstliche-Intelligenz-Sprachmodell. Wir schauen etwas hinter die Kulissen, wie das „large language model“ GPT-3 und das darauf aufsetzende ChatGPT funktionieren.

- Die KI ChatGPT und die Herausforderungen für die GesellschaftWas lange währt, wird endlich, äh, published. Mein neuer DNIP-Artikel zu ChatGPT ist online, in drei Teilen:

- Identifikation von KI-KunstKI-Kunst ist auf dem Vormarsch, sowohl was die Qualität als auch die Quantität betrifft. Es liegt (leider) in der menschlichen Natur, einiges davon als „echte“, menschgeschaffene Kunst zu vermarkten. Hier… Identifikation von KI-Kunst weiterlesen

- Die Lieblingsfragen von ChatGPTEntmutigt durch die vielen Antworten von ChatGPT, es könne mir auf diese oder jene Frage keine Antwort geben, weil es nur ein von OpenAI trainiertes Sprachmodell sei, versuchte ich, ChatGPT… Die Lieblingsfragen von ChatGPT weiterlesen

- Wie funktioniert Künstliche Intelligenz?Am vergangenen Mittwoch habe ich im Rahmen der Volkshochschule Stein am Rhein einen Überblick über die Mächtigkeit, aber auch die teilweise Ohnmächtigkeit der Künstlichen Intelligenz gegeben. Das zahlreich anwesende Publikum… Wie funktioniert Künstliche Intelligenz? weiterlesen

- Künstliche Intelligenz — und jetzt?Am 16. November 2022 halte ich einen öffentlichen Vortrag zu künstlicher Intelligenz an der VHS Stein am Rhein. Sie sind herzlich eingeladen. Künstliche Intelligenz ist derzeit in aller Munde und… Künstliche Intelligenz — und jetzt? weiterlesen

- Reproduzierbare KI: Ein SelbstversuchIm NZZ Folio vom 6. September 2022 beschrieb Reto U. Schneider u.a., wie er mit DALL•E 2 Bilder erstellte. Die Bilder waren alle sehr eindrücklich. Ich fragte mich allerdings, wie viele… Reproduzierbare KI: Ein Selbstversuch weiterlesen

- Machine Learning: Künstliche Faultier-IntelligenzMachine Learning („ML“) wird als Wundermittel angepriesen um die Menschheit von fast allen repetitiven Verarbeitungsaufgaben zu entlasten: Von der automatischen Klassifizierung von Strassenschilden über medizinische Auswertungen von Gewebeproben bis zur… Machine Learning: Künstliche Faultier-Intelligenz weiterlesen

Schreibe einen Kommentar