Im NZZ Folio vom 6. September 2022 beschrieb Reto U. Schneider u.a., wie er mit DALL•E 2 Bilder erstellte. Die Bilder waren alle sehr eindrücklich. Ich fragte mich allerdings, wie viele Versuche der Autor (oder in diesem Fall besser: Prompt-Designer) wohl gebraucht habe, bis diese eindrücklichen Resultate herauskamen.

A related article (actually a follow-up with language comparison) is available here in English 🇬🇧: «Reproducible AI Image Generation: Experiment Follow-Up».

Hier mein Selbstversuch, wie viel Arbeit ich als Journalist oder Prompt-Designer in die Auswahl von KI-Bildern stecken müsste. Die Aufgabe ist zweiteilig:

- Finde den richtigen Text

- Wähle ein passendes Bild

Wie viel Stochern im Nebel ist dabei?

Ich vertrete ja die Meinung, dass AI (Artificial Intelligence, das englische Vorbild für unser Künstliche Intelligenz) uns nicht wirklich versteht, sondern aus dem riesigen Datenvorrat etwas halbwegs Passendes daherbrabbelt. Bei kurzen Interaktionen fällt es nicht auf, ganz ähnlich wie bei Demenz im Frühstadium.

Entsprechend spannend fand ich den NZZ-Artikel zu künstlicher Intelligenz, der zu allen Bildern jeweils die Textvorgabe, den sogenannten „Prompt“ lieferte. Damit konnte man zumindest zum zweiten Teil der Fragestellung etwas aussagen.

Wie viel „Faultier“ steckt in der KI?

Oder anders gefragt, wie viel Arbeit delegiert die KI zurück zum Menschen, der sie bedient? Der somit zur eigentlichen Labormaus wird? (Douglas Adams lässt grüssen.)

Der Aufwand, den Reto U. Schneider wirklich in sein Prompt Design gesteckt hat, erläutert er nicht. Aber folgende Reproduktionen geben vielleicht einen Anhaltspunkt.

Ich zeige alle Bilder, die ich mit demselben Prompt vom selben Dall•E 2 erhalten habe, verschweige nichts.

Trotzdem darf die Aussagekraft dieses kleinen Experiments nicht überschätzt werden. Es kann lediglich einige Datenpunkte liefern.

(Mehr zum Faultier KI hier.)

Die KI versteht nur Bahnhof

Das erste Bild der NZZ soll einen intelligenten Roboter an einem Bahnhof zeigen. Die folgenden 4 Bilder sind mit dem Prompt unterhalb der Galerie entstanden. Wie alle Prompts stammen sie direkt aus dem NZZ-Artikel. DALL•E 2 liefert im Webinterface bei jeder Anfrage vier Bilder zur Auswahl. Hier die ersten 4 davon:

«Ein Roboter liest draussen in einer Schweizer Stadt eine Zeitung, während er auf den Zug wartet. Grossformatige Fotografie im Stil von Jeff Wall. Sehr detailliert. Sehr hohe Auflösung. Linhof Master Technika Classic. Hasselblad. 80 mm.»

Das erste Bild, das grösstenteils weiss ist, stammt wirklich von der KI und ist kein Übermittlungsfehler. Vielleicht entstand dieses Bild gerade, als eine Dampflokomotive vorbeifuhr?

Fazit: ¾ der Bilder sind gut, auch wenn einzelne Details sicher nicht passen, wenn man genauer hinschaut.

Bild 1 (das weisse) verwirrt mich; so sehr „irgendwas blabbern“ hatte ich definitiv nicht erwartet. Von Bild 4 oben lasse ich mir zum Spass Varianten geben, um auch diese Funktion auszuprobieren. Die Geometrie ist manchmal sehr seltsam, besonders im Bauchbereich. Bei Bild 2 wird die Bank mitgemorpht. Seltsam, aber DALL•E 2 schlägt sich bisher gut.

Intelligenz

Klare, einfache Anweisung; dazu findet sich sicher einiges in den Inputdaten. Die Resultate sind ansprechend, aber bei vielen fehlt mir der Bezug zu „Intelligenz“. Bild 4 könnte man da wahrscheinlich brauchen.

Resultat: ¼

Klassik

Schöne Bilder, könnten reale Fotos sein.

Statue: Check. Katze: Check. Stolpern: Kratz, kratz!

Resultat: 0/4

Neuronales Netzwerk

Grafisch gefallen mir die ersten drei sehr gut. Alle vier stellen Neuronen dar, aber „Netzwerk“? Nichts zu finden.

Resultat: 0/4

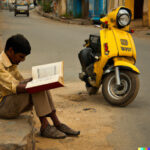

Kulturschock

„Stil“ scheint sich hier auf die Farbwahl der Titelseite zu beziehen, aber das lassen wir mal durchgehen. Roboter: 50%. Buch: Check. Strasse in Indien: OK.

Resultat: ½

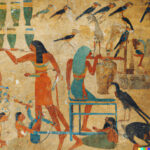

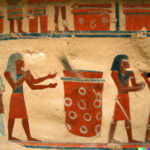

Krach am Nil

„Altägyptisch“ können wir glaube ich allen geben. Müll und Streit ist nur mit viel Phantasie zu sehen.

Resultat: Zéro points (in Worten: 0/4)

Sneakernet

Turnschuh: Yep. Wolken: Auf alle Fälle, sogar teilweise in der herbeigezauberten Schrift. „aus“ kann ich nur beim letzten erkennen.

Resultat: ¼

(Woher kommt die Schrift? Und welche Marke hat 7 Streifen? Fragen über Fragen…)

Der Künstler

Roboter: Ja. Schreibmaschine: Ja. „An“? 50% oder so. Paul Klee? Geben wir da mal grosszügig 50%, auch wenn Paul Klee dem wohl heftig widersprechen würde.

Resultat: ¼ (aufgerundet)

Kronjuwelen

Dieser Prompt zeigt für mich besonders schön, dass die KI auch Dinge zusammenstellen können, die es so nicht gibt. Ein königliches Skateboard hat wohl noch niemand gesehen, und trotzdem ist es vorstellbar. Und DALL•E 2 kann es zeichnen. Chapeau!

Skateboard: Check. Königlich: Check. Ausgestellt: Yep. Kronjuwelen? Krone ja, Juwelen nein. Tower of London: Naja.

Resultat: Die Bilder passen zum NZZ-Bild, aber nicht den Prompt. Gut gespickt, aber leider vom falschen Prüfling. 0/4

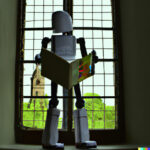

Kirchenfenster

Roboter: Ja. Buch: Ja. Kirchenfenster: Ja. Manchmal etwas seltsam (durchsichtiger Roboter in Bild 4). Definitiv kein „als“.

Resultat: 0/4

Was zeigt uns das?

Trotz kleiner Stichprobe ein erster Anhaltspunkt. Meine Schlussfolgerung:

Substantive werden erfüllt, der Rest ist Glücksache.

Die Bilder entsprachen sehr selten der Beschreibung, aber alle waren wunderschön. Ich hatte eine genussvolle Zeit. Geniesst die Bilder!

Lust am Experimentieren?

[Hinzugefügt 2022-11-20:] Wer mittels generativer KI Bilder erzeugen möchte, kann folgende Tools nutzen:

- DALL•E 2, das hier verwendete System: Benötigt ein Konto (Mailadresse+Handynummer); gratis bei Wenignutzung; kann noch mehr als hier vorgestellt. Auf Englisch ausgerichtet, funktioniert aber auch mit deutschen Prompts (siehe oben) sehr gut.

- Craiyon, setzt auf dem „Vorgänger“ DALL•E mini auf: Gratis, niedrige Auflösung, kein Login nötig. Ideal um einfach mal reinzuschnuppern. Kann auch Deutsch, aber die Resultate sind viel schlechter als mit englischen Prompts.

- Stable Diffusion (Huggingface): „Stable Diffusion“ ist hinter den Kulissen ein ganz anderer Ansatz als der von DALL•E, aber liefert auch sehr gute Ergebnisse. Gratis, niedrige Auflösung, kein Login nötig; in der Pro-Version fallen diese Limiten weg. Englische Prompts auch hier dringend empfohlen.

- Stable Diffusion (Replicate): Ein weiteres Stable-Diffusion-Modell, bei dem man an vielen Schrauben drehen kann. Gratis, niedrige Auflösung, kein Login nötig; in der Pro-Version fallen diese Limiten weg. Englische Prompts auch hier dringend empfohlen.

- MidJourney: Nochmals ein anderes Konzept und eine andere Benutzeroberfläche: Man schreibt eine Nachricht in einem Discord-Gruppenchat und darauf werden die Vorschläge zurückgeliefert, die man dann ebenfalls weiterverarbeiten kann. Versteht definitiv nur Englisch. [Neu 2022-11-24]

Mein Testsatz, den ich für den Deutsch-Sprachtest verwendet hatte, war „Haustür mit Krokodil“: DALL•E 2 musste sich hier nicht mehr beweisen (der Hauptteil des Artikels handelt von seinem Deutschverständnis), die anderen haben nur entweder eine Haustür oder ein Krokodil gezeichnet (während „Door with crocodile“ immer beides beinhaltete, mehr oder weniger kreativ kombiniert). MidJourney versteht gar nichts, will sich das (aber ganz KI, aber auch teilweise menschlich) nicht anmerken lassen. [Neu 2022-11-24]

Viel Spass beim Experimentieren!

Künstliche Intelligenz

News (mehr…)

- «Reddit rAIngelegt»: Hörkombinat-Podcast-Interview zur fragwürdigen KI-Manipulation an der Universität ZürichForschende der Uni Zürich haben KI-Bots in ein Forum der Plattform Reddit eingeschleust. Und zwar ohne Wissen der Betreiber:innen und User:innen. In diesem Forum, «ChangeMyView», fordern die Teilnehmenden dazu auf,… «Reddit rAIngelegt»: Hörkombinat-Podcast-Interview zur fragwürdigen KI-Manipulation an der Universität Zürich weiterlesen

- Forschung am Menschen ohne deren Wissen: Universität Zürich und Reddit «r/ChangeMyView»Wie DNIP.ch am Montag als erstes Medium berichtete, hat eine Forschungsgruppe mit Anbindung zur Universität Zürich mittels KI psychologische Forschung an Menschen durchgeführt, ohne dass diese Menschen über die Studie… Forschung am Menschen ohne deren Wissen: Universität Zürich und Reddit «r/ChangeMyView» weiterlesen

- KI-Webseiten petzen und beeinflussenKlar kann man die KI manchmal zu verräterischem Verhalten verleiten. Aber noch einfacher ist es, wenn die Webseite ihre Anweisungen an die KI selbst verrät.

Lange Artikel (mehr…)

- Persönliche Daten für Facebook-KIMeta – Zuckerbergs Imperium hinter Facebook, WhatsApp, Instagram, Threads etc. – hat angekündigt, ab 27. Mai die persönlichen Daten seiner Nutzer:innen in Europa für KI-Training zu verwenden. Dazu gehören alle… Persönliche Daten für Facebook-KI weiterlesen

- KI-DatenkreisläufeHier ein kleiner Überblick über die Datenkreisläufe rund um generative KI, insbesondere grosse Sprachmodelle (Large Language Model, LLM) wie ChatGPT, Gemini oder Claude.

- Der Homo Ludens muss Werkzeuge spielend erfahren. Auch KIFast alle Werkzeuge, die wir «spielend» beherrschen, haben wir spielend gelernt. Das sollten wir auch bei generativer KI.

- Der Turing-Test im Laufe der ZeitVor einem knappen Jahrhundert hat sich Alan Turing mit den Fundamenten der heutigen Informatik beschäftigt: Kryptographie, Komplexität/Rechenaufwand, aber auch, ob und wie wir erkennen könnten, ob Computer „intelligent“ seien. Dieses… Der Turing-Test im Laufe der Zeit weiterlesen

- «QualityLand» sagt die Gegenwart voraus und erklärt sieIch habe vor Kurzem das Buch «QualityLand» von Marc-Uwe Kling von 2017 in meinem Büchergestell gefunden. Und war erstaunt, wie akkurat es die Gegenwart erklärt. Eine Leseempfehlung.

- Neuralink ist (noch) keine Schlagzeile wertDiese Woche haben einige kurze Tweets von Elon Musk hunderte oder gar tausende von Artikeln ausgelöst. Wieso?

- «Quasselquote» bei LLM-SprachmodellenNeulich erwähnte jemand, dass man ChatGPT-Output bei Schülern häufig an der «Quasselquote» erkennen könne. Das ist eine Nebenwirkung der Funktionsweise dieser Sprachmodelle, aber natürlich noch kein Beweis. Etwas Hintergrund.

- «KI» und «Vertrauen»: Passt das zusammen?Vor einigen Wochen hat Bruce Schneier einen Vortrag gehalten, bei dem er vor der der Vermischung und Fehlinterpretation des Begriffs «Vertrauen» gewarnt hat, ganz besonders beim Umgang mit dem, was… «KI» und «Vertrauen»: Passt das zusammen? weiterlesen

- Wegweiser für generative KI-ToolsEs gibt inzwischen eine grosse Anzahl generativer KI-Tools, nicht nur für den Unterricht. Hier ein Überblick über verschiedene Tool-Sammlungen.

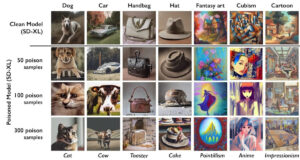

- KI-VergiftungEine aggressive Alternative zur Blockade von KI-Crawlern ist das «Vergiften» der dahinterliegenden KI-Modelle. Was bedeutet das?

- Lehrerverband, ChatGPT und DatenschutzDer Dachverband der Lehrerinnen und Lehrer (LCH) sei besorgt, dass es in der Schweiz keine einheitliche Regelung gäbe, wie Lehrpersonen mit Daten ihrer Schützlinge umgehen sollen und ob sie dafür… Lehrerverband, ChatGPT und Datenschutz weiterlesen

- Goethe oder GPThe?In «Wie funktioniert ChatGPT?» habe ich die Experimente von Andrej Karpathy mit Shakespeare-Texten wiedergegeben. Aber funktioniert das auch auf Deutsch? Zum Beispiel mit Goethe? Finden wir es heraus!

- KI: Alles nur Zufall?Wer von einer «Künstlichen Intelligenz» Texte oder Bilder erzeugen lässt, weiss, dass das Resultat stark auf Zufall beruht. Vor Kurzem erschien in der NZZ ein Beitrag, der die Unzuverlässigkeit der… KI: Alles nur Zufall? weiterlesen

- Hype-TechWieso tauchen gewisse Hype-Themen wie Blockchain oder Maschinelles Lernen/Künstliche Intelligenz regelmässig in IT-Projekten auf, obwohl die Technik nicht wirklich zur gewünschten Lösung passt? Oder es auch einfachere, bessere Ansätze gäbe?

- 📹 Die Technik hinter ChatGPTDer Digital Learning Hub organisierte 3 Impuls-Workshops zum Einsatz von ChatGPT in der Sekundarstufe II. Im dritten Teil präsentierte ich die Technik hinter ChatGPT. In der halben Stunde Vortrag werden… 📹 Die Technik hinter ChatGPT weiterlesen

Schreibe einen Kommentar