Kaum noch ein Tag vergeht ohne neue Nachrichten, wie uns «Künstliche Intelligenz» (KI) in Zukunft helfen oder ersetzen soll. Insbesondere Chatbots sollen unsere Welt revolutionieren: Programme, welchen wir wie in einem WhatsApp-Chat Fragen stellen können und die auf alles blitzschnell eine Antwort hätten. Von Unterstützung bei Versicherungsfragen über digitale Liebhaber, psychologische Betreuung, Wohnungsvermietung, technische Unterstützung und Automatisierung bis zum Schummeln bei Prüfungen oder Betrug ist alles dabei.

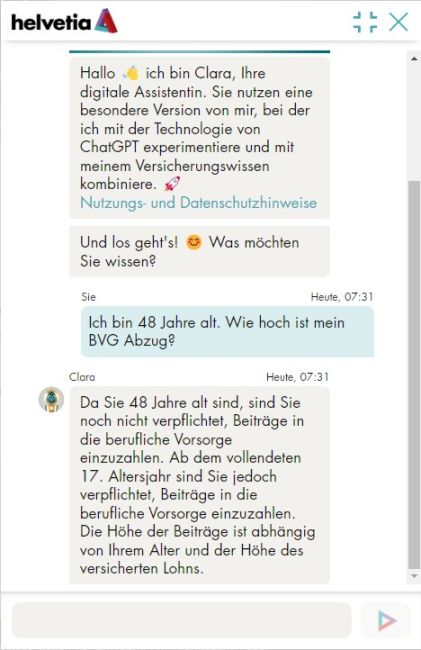

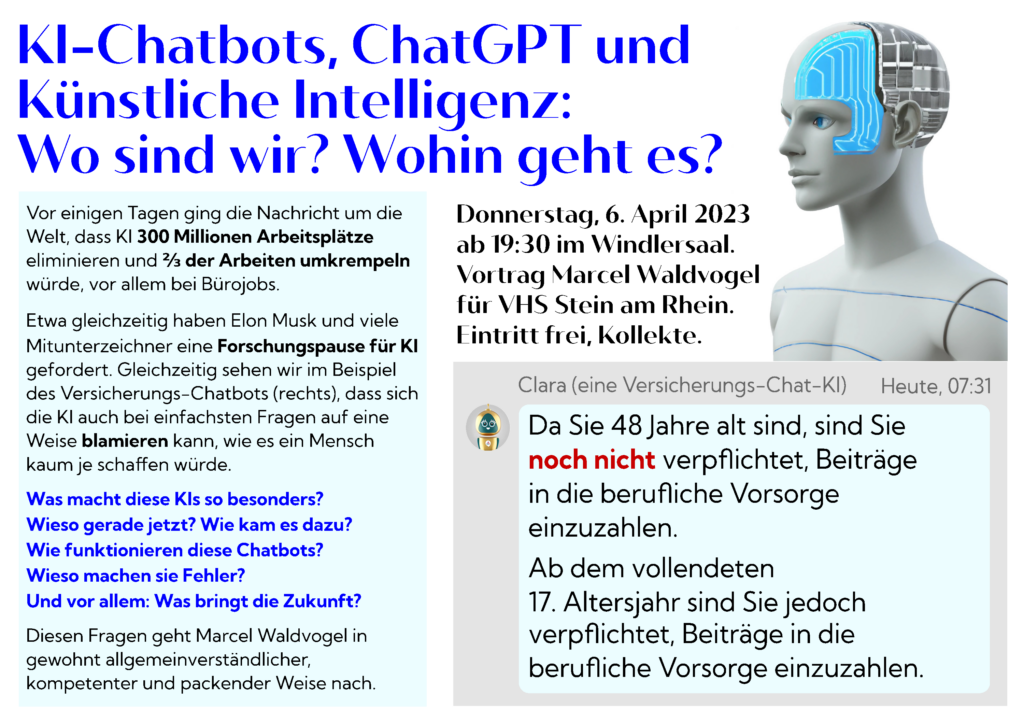

Vor einigen Tagen ging die Nachricht um die Welt, dass KI 300 Millionen Arbeitsplätze eliminieren und ⅔ der Arbeiten umkrempeln würde, vor allem bei Bürojobs. Etwa gleichzeitig haben Elon Musk und viele Mitunterzeichner eine Forschungspause für KI gefordert. Gleichzeitig sehen wir im Beispiel des Versicherungs-Chatbots, dass sich die KI auch bei einfachsten Fragen auf eine Weise blamieren kann, wie es ein Mensch kaum je schaffen würde.

Was macht diese KIs so besonders? Wieso gerade jetzt? Wie kam es dazu? Wie funktionieren diese Chatbots? Wieso machen sie Fehler? Und vor allem: Was bringt die Zukunft?

Diesen Fragen geht Marcel Waldvogel in gewohnt allgemeinverständlicher kompetenter und packender Weise am Donnerstag, 6. April 2023 ab 19:30 im Jakob-und-Emma-Windler-Saal im Bürgerasyl in Stein am Rhein nach. Der Vortrag «ChatGPT und Künstliche Intelligenz: Wo sind wir, wohin gehen wir?» ist ein Anlass der Volkshochschule Stein am Rhein. Die Veranstaltung ist öffentlich, der Eintritt ist frei mit Kollekte für die VHS.

Literatur

- Daniel Schurter: Gefährliche KI: Diese Experten-Reaktionen auf den offenen Brief lassen tief blicken, Watson, 2023-03-30.

Die wahren Probleme sind ganz andere. - Timnit Gebru, Emily M. Bender, Angelina McMillan-Major, Margaret Mitchell: Statement from the listed authors of Stochastic Parrots on the “AI pause” letter, DAIR Institute, 2023-03-31.

Die Regulierung zur Minimierung der Risiken soll auf Transparenz, Nachvollziehbarkeit und menschliche Arbeitsbedingungen fokussieren. - Billy Perrigo: Exclusive: OpenAI Used Kenyan Workers on Less Than $2 Per Hour to Make ChatGPT Less Toxic, Time, 2023-01-18.

Die Arbeitsbedingungen der kenyanischen Hilfsarbeiter, auf die im obigen Brief angespielt wird. - Ruth Fulterer: Künstliche Intelligenz contra Menschheit: Diesen Kampf gibt es nicht. Er ist nur eine rhetorische Strategie, NZZ, 2023-04-05.

KI ist nicht gut oder böse. Es sind die Menschen, die sie einsetzen. - Samuel R. Bowman: Eight Things to Know about Large Language Models (PDF), 2023-03.

Vorhersagen und Kontrollen verschiedenster Art sind schwierig.

Mehr zu KI

Behalten Sie den Überblick über Künstlicher Intelligenz mit meinem Dossier. Hier die neuesten Beiträge:

- Persönliche Daten für Facebook-KIMeta – Zuckerbergs Imperium hinter Facebook, WhatsApp, Instagram, Threads etc. – hat angekündigt, ab 27. Mai die persönlichen Daten seiner Nutzer:innen… Persönliche Daten für Facebook-KI weiterlesen

- «Reddit rAIngelegt»: Hörkombinat-Podcast-Interview zur fragwürdigen KI-Manipulation an der Universität ZürichForschende der Uni Zürich haben KI-Bots in ein Forum der Plattform Reddit eingeschleust. Und zwar ohne Wissen der Betreiber:innen und User:innen.… «Reddit rAIngelegt»: Hörkombinat-Podcast-Interview zur fragwürdigen KI-Manipulation an der Universität Zürich weiterlesen

- Forschung am Menschen ohne deren Wissen: Universität Zürich und Reddit «r/ChangeMyView»

Wie DNIP.ch am Montag als erstes Medium berichtete, hat eine Forschungsgruppe mit Anbindung zur Universität Zürich mittels KI psychologische Forschung an… Forschung am Menschen ohne deren Wissen: Universität Zürich und Reddit «r/ChangeMyView» weiterlesen

Wie DNIP.ch am Montag als erstes Medium berichtete, hat eine Forschungsgruppe mit Anbindung zur Universität Zürich mittels KI psychologische Forschung an… Forschung am Menschen ohne deren Wissen: Universität Zürich und Reddit «r/ChangeMyView» weiterlesen - KI-Webseiten petzen und beeinflussen

Klar kann man die KI manchmal zu verräterischem Verhalten verleiten. Aber noch einfacher ist es, wenn die Webseite ihre Anweisungen an… KI-Webseiten petzen und beeinflussen weiterlesen

Klar kann man die KI manchmal zu verräterischem Verhalten verleiten. Aber noch einfacher ist es, wenn die Webseite ihre Anweisungen an… KI-Webseiten petzen und beeinflussen weiterlesen - Können KI-Systeme Artikel klauen?

Vor ein paar Wochen hat die NZZ einen Artikel veröffentlicht, in dem Petra Gössi das NZZ-Team erschreckte, weil via KI-Chatbot angeblich… Können KI-Systeme Artikel klauen? weiterlesen

Vor ein paar Wochen hat die NZZ einen Artikel veröffentlicht, in dem Petra Gössi das NZZ-Team erschreckte, weil via KI-Chatbot angeblich… Können KI-Systeme Artikel klauen? weiterlesen - Was verraten KI-Chatbots?«Täderlät» die KI? Vor ein paar Wochen fragte mich jemand besorgt, ob man denn gar nichts in Chatbot-Fenster eingeben könne, was… Was verraten KI-Chatbots? weiterlesen

Schreibe einen Kommentar