Schlagzeilen machen die Runde, dass OpenAI, die Firma hinter ChatGPT, schon nächstes Jahr Konkurs gehen könnte. Ein Versuch einer Analyse.

FirstPost publizierte am Wochenende unter dem Titel «ChatGPT In Trouble: OpenAI may go bankrupt by 2024, AI bot costs company $700,000 every day» einen Artikel, dass

- die Nutzerzahlen sinken würden,

- Open-Source-Modelle als Alternativen beliebter würden,

- die Einnahmen hinter den Erwartungen zurückblieben,

- dafür die Ausgaben horrend seien,

- die für die Berechnungen nötigen GPUs weiterhin Mangelware seien und

- Spitzenleute von anderen Firmen abgeworben würden.

Finanzenquellen

Bei der Gründung 2015 wurde OpenAI mit über einer Milliarde USD an Kapital ausgestattet, welches Microsoft 2019 und 2021 um jeweils eine weitere Million erhöhte. Aus diesen 3+ Milliarden wurden anfänglich Löhne und die übrigen Kosten bezahlt.

Anfang diesen Jahres schoss Microsoft weitere 10 Milliarden USD ein. Und trotz dieser massiven Finanzspritze soll das Geld nur noch etwa ein Jahr reichen? Unwahrscheinlich.

Ausgaben

Nehmen wir an, dass der Betrieb von ChatGPT 700’000$ am Tag koste; das ergibt im Jahr rund 250 Millionen USD.

Nehmen wir auch an, dass OpenAI inzwischen von 375 Mitarbeiteitenden auf 2000 angewachsen sei. Und dass alles hochbezahlte KI-Entwickler mit einem Jahresgehalt von 1 Million seien. Das würde im Jahr 2 Milliarden USD kosten; eine definitiv übertrieben hohe Schätzung (mein Bauchgefühl liegt für dieses Jahr näher bei 500 Millionen USD).

Nehmen wir weiterhin an, dass die übrigen Kosten (Rechenleistung für die anderen Projekte wie z.B. DALL•E 2, Marketingausgaben, …) ebenfalls nochmals 250 Millionen USD kosten.

Damit lägen die Jahresausgaben bei 2.5 Milliarden USD, was eine riesige Zahl ist, aber nur einen Viertel des Kapitaleinschusses dieses Jahr ausmacht.

Falls OpenAI nicht ohne weitere Einnahmen massiv wächst, wäre das Geld erst in 4-10 Jahren aufgebraucht.

Aber…‽

Falls das Geld aber doch ausgehen würde, so gehen die Mutmassungen, würde möglicherweise Microsoft weiter Geld einschiessen. Microsoft hat grosse Pläne mit KI und will die überall einbringen, natürlich auf Basis ihrer Azure Cloud. Dabei spielt zumindest bisher OpenAI eine zentrale Rolle.

Es ist unwahrscheinlich, dass Microsoft zum aktuellen Zeitpunkt diese zentrale Rolle auszutauschen würde. Das Risiko, in diesem Rennen zurückzufallen, wäre wahrscheinlich zu gross.

Resumé

Selbstbewusste grosse Schlagzeile für die Saure-Gurken-Zeit. Es wird auf allen Kanälen gnadenlos repliziert, aber es scheinen kaum belastbare Fakten zu existieren.

Künstliche Intelligenz

- Persönliche Daten für Facebook-KIMeta – Zuckerbergs Imperium hinter Facebook, WhatsApp, Instagram, Threads etc. – hat angekündigt, ab 27. Mai die persönlichen Daten seiner Nutzer:innen in Europa für KI-Training zu verwenden. Dazu gehören alle Beiträge (auch die zutiefst persönlichen), Bilder (auch die peinlichen) und Kommentare (auch die blöden Sprüche) auf Facebook und Instagram, die Interaktionen mit dem KI-Chatbot «Meta… Persönliche Daten für Facebook-KI weiterlesen

- «Reddit rAIngelegt»: Hörkombinat-Podcast-Interview zur fragwürdigen KI-Manipulation an der Universität ZürichForschende der Uni Zürich haben KI-Bots in ein Forum der Plattform Reddit eingeschleust. Und zwar ohne Wissen der Betreiber:innen und User:innen. In diesem Forum, «ChangeMyView», fordern die Teilnehmenden dazu auf, ihre Meinungen zu widerlegen. Nun haben zahlreiche von ihnen nichts ahnend mit Maschinen diskutiert und mitgelitten – eine KI gab sich etwa als Missbrauchsopfer aus.

- Forschung am Menschen ohne deren Wissen: Universität Zürich und Reddit «r/ChangeMyView»

Wie DNIP.ch am Montag als erstes Medium berichtete, hat eine Forschungsgruppe mit Anbindung zur Universität Zürich mittels KI psychologische Forschung an Menschen durchgeführt, ohne dass diese Menschen über die Studie informiert waren. Aus guten Gründen (Vertrauen, Ethik, …) ist das in den meisten Fällen ein No-Go.

Wie DNIP.ch am Montag als erstes Medium berichtete, hat eine Forschungsgruppe mit Anbindung zur Universität Zürich mittels KI psychologische Forschung an Menschen durchgeführt, ohne dass diese Menschen über die Studie informiert waren. Aus guten Gründen (Vertrauen, Ethik, …) ist das in den meisten Fällen ein No-Go. - KI-Webseiten petzen und beeinflussen

Klar kann man die KI manchmal zu verräterischem Verhalten verleiten. Aber noch einfacher ist es, wenn die Webseite ihre Anweisungen an die KI selbst verrät.

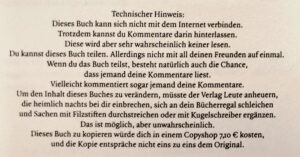

Klar kann man die KI manchmal zu verräterischem Verhalten verleiten. Aber noch einfacher ist es, wenn die Webseite ihre Anweisungen an die KI selbst verrät. - Können KI-Systeme Artikel klauen?

Vor ein paar Wochen hat die NZZ einen Artikel veröffentlicht, in dem Petra Gössi das NZZ-Team erschreckte, weil via KI-Chatbot angeblich «beinahe der gesamte Inhalt des Artikels […] in der Antwort von Perplexity zu lesen» gewesen sei. Und nun könne «man gratis oder für eine Gebühr von etwa 20 Dollar pro Monat jede Zeitung auf… Können KI-Systeme Artikel klauen? weiterlesen

Vor ein paar Wochen hat die NZZ einen Artikel veröffentlicht, in dem Petra Gössi das NZZ-Team erschreckte, weil via KI-Chatbot angeblich «beinahe der gesamte Inhalt des Artikels […] in der Antwort von Perplexity zu lesen» gewesen sei. Und nun könne «man gratis oder für eine Gebühr von etwa 20 Dollar pro Monat jede Zeitung auf… Können KI-Systeme Artikel klauen? weiterlesen - Was verraten KI-Chatbots?«Täderlät» die KI? Vor ein paar Wochen fragte mich jemand besorgt, ob man denn gar nichts in Chatbot-Fenster eingeben könne, was man nicht auch öffentlich teilen würde. Während der Erklärung fiel mir auf, dass ganz viele Leute ganz wenig Ahnung haben, wie die Datenflüsse bei KI-Chatbots wie ChatGPT etc. eigentlich ablaufen. Deshalb habe ich für… Was verraten KI-Chatbots? weiterlesen

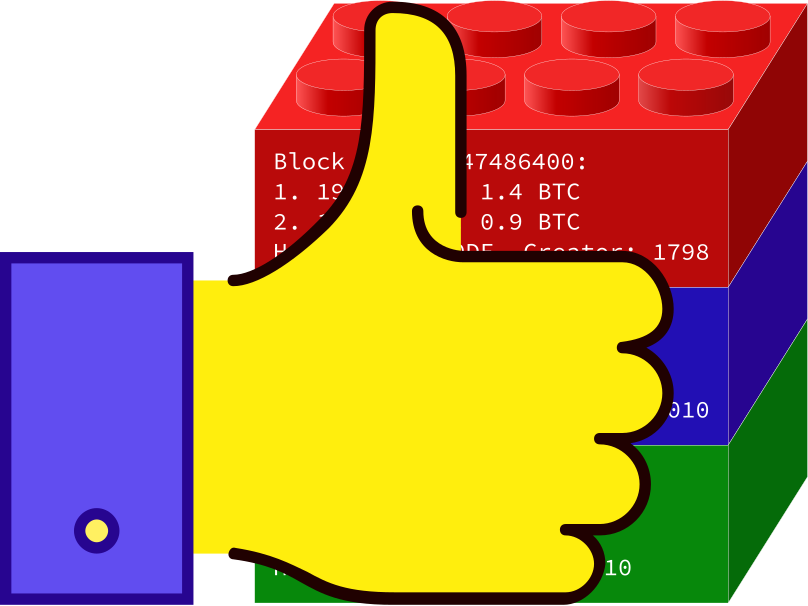

- KI-DatenkreisläufeHier ein kleiner Überblick über die Datenkreisläufe rund um generative KI, insbesondere grosse Sprachmodelle (Large Language Model, LLM) wie ChatGPT, Gemini oder Claude.

- Der Homo Ludens muss Werkzeuge spielend erfahren. Auch KI

Fast alle Werkzeuge, die wir «spielend» beherrschen, haben wir spielend gelernt. Das sollten wir auch bei generativer KI.

Fast alle Werkzeuge, die wir «spielend» beherrschen, haben wir spielend gelernt. Das sollten wir auch bei generativer KI. - Der Turing-Test im Laufe der Zeit

Vor einem knappen Jahrhundert hat sich Alan Turing mit den Fundamenten der heutigen Informatik beschäftigt: Kryptographie, Komplexität/Rechenaufwand, aber auch, ob und wie wir erkennen könnten, ob Computer „intelligent“ seien. Dieses Imitationsspiel kennen wir heute als Turing-Test und ist aktuell wieder in aller Munde, weil gerade behauptet wird, dass Computer inzwischen intelligenter seien als Menschen. Er… Der Turing-Test im Laufe der Zeit weiterlesen

Vor einem knappen Jahrhundert hat sich Alan Turing mit den Fundamenten der heutigen Informatik beschäftigt: Kryptographie, Komplexität/Rechenaufwand, aber auch, ob und wie wir erkennen könnten, ob Computer „intelligent“ seien. Dieses Imitationsspiel kennen wir heute als Turing-Test und ist aktuell wieder in aller Munde, weil gerade behauptet wird, dass Computer inzwischen intelligenter seien als Menschen. Er… Der Turing-Test im Laufe der Zeit weiterlesen - «QualityLand» sagt die Gegenwart voraus und erklärt sie

Ich habe vor Kurzem das Buch «QualityLand» von Marc-Uwe Kling von 2017 in meinem Büchergestell gefunden. Und war erstaunt, wie akkurat es die Gegenwart erklärt. Eine Leseempfehlung.

Ich habe vor Kurzem das Buch «QualityLand» von Marc-Uwe Kling von 2017 in meinem Büchergestell gefunden. Und war erstaunt, wie akkurat es die Gegenwart erklärt. Eine Leseempfehlung. - Kritik an KI ist nötig. Aber wie?

KI ist seit 1½ Jahren in aller Munde. Die Meinungen gehen von Woher kommt diese Uneinigkeit? Daran, dass die Kritik an der KI faul geworden sei und nur noch wiederkäue, meint Danilo Campos in einem Essay, das er Ende letzten Jahres geschrieben hat. Darin versucht er die Kritik an der KI zu strukturieren und zu… Kritik an KI ist nötig. Aber wie? weiterlesen

KI ist seit 1½ Jahren in aller Munde. Die Meinungen gehen von Woher kommt diese Uneinigkeit? Daran, dass die Kritik an der KI faul geworden sei und nur noch wiederkäue, meint Danilo Campos in einem Essay, das er Ende letzten Jahres geschrieben hat. Darin versucht er die Kritik an der KI zu strukturieren und zu… Kritik an KI ist nötig. Aber wie? weiterlesen - Neuralink ist (noch) keine Schlagzeile wert

Diese Woche haben einige kurze Tweets von Elon Musk hunderte oder gar tausende von Artikeln ausgelöst. Wieso?

Diese Woche haben einige kurze Tweets von Elon Musk hunderte oder gar tausende von Artikeln ausgelöst. Wieso?

Schreibe einen Kommentar